| 年小组动态 |

| 其它年份小组动态 |

|

武汉大学测绘遥感信息工程全国重点实验室RSIDEA团队提出了首个面向无人机(UAV)边缘端实时灾害损毁评估的知识蒸馏框架DisasterKD,通过“灾害场景高-低频率引导的知识分解”和“跨解码器知识迁移”两项关键设计,在不增加部署端推理开销的前提下显著提升轻量模型在灾后复杂场景中的分割与损毁评估能力。相关研究成果 “DisasterKD: Frequency-guided cross-decoder knowledge distillation for UAV real-time disaster damage assessment” 发表于国际权威期刊 Pattern Recognition (PR)。武汉大学测绘遥感信息工程全国重点实验室博士生郭鉴翀为第一作者,万瑜廷副教授为通讯作者、钟燕飞教授、马爱龙副教授和东京大学王俊珏博士共同参与完成研究。

代码已开源(https://github.com/SummerTide/DisasterKD.git),欢迎学术用途下载与交流合作。

研究背景

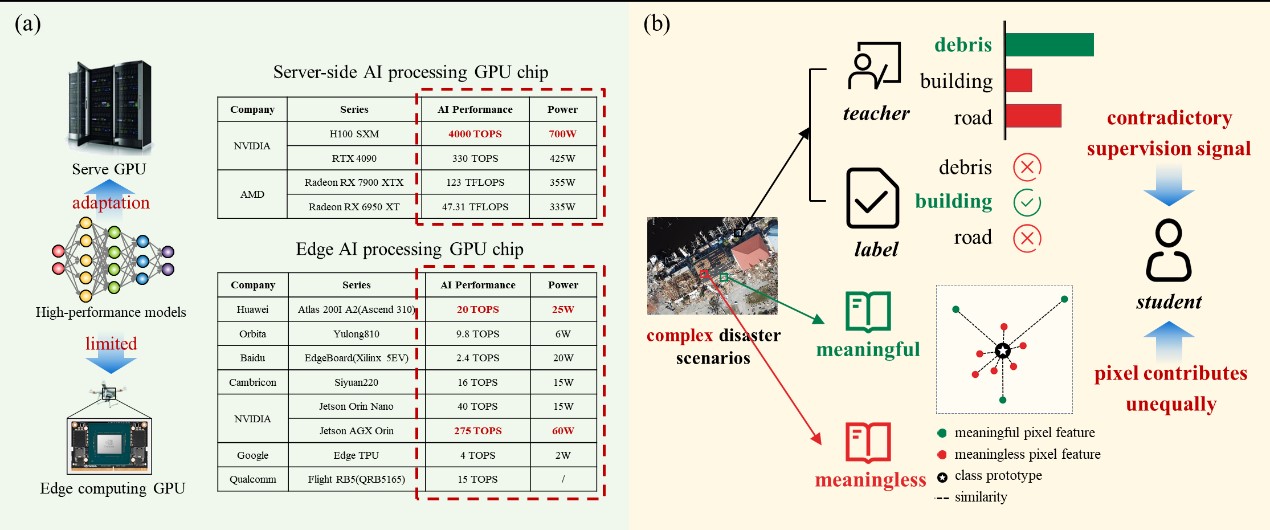

无人机实时遥感灾害损毁评估需要在资源受限的边缘设备上运行轻量级模型,而知识蒸馏是实现模型压缩与端侧部署的有效途径。然而,灾害场景具有显著的复杂性与异质性,灾后影像呈现混乱的视觉模式与不规则的损毁边界,使得传统蒸馏方法难以准确识别并传递对损毁判别最关键的信息。同时,在严重受灾区域,教师模型预测与真实标注之间往往存在不一致,容易引入相互矛盾的监督信号,进而破坏学生模型训练的稳定性并降低知识传递效果。

|

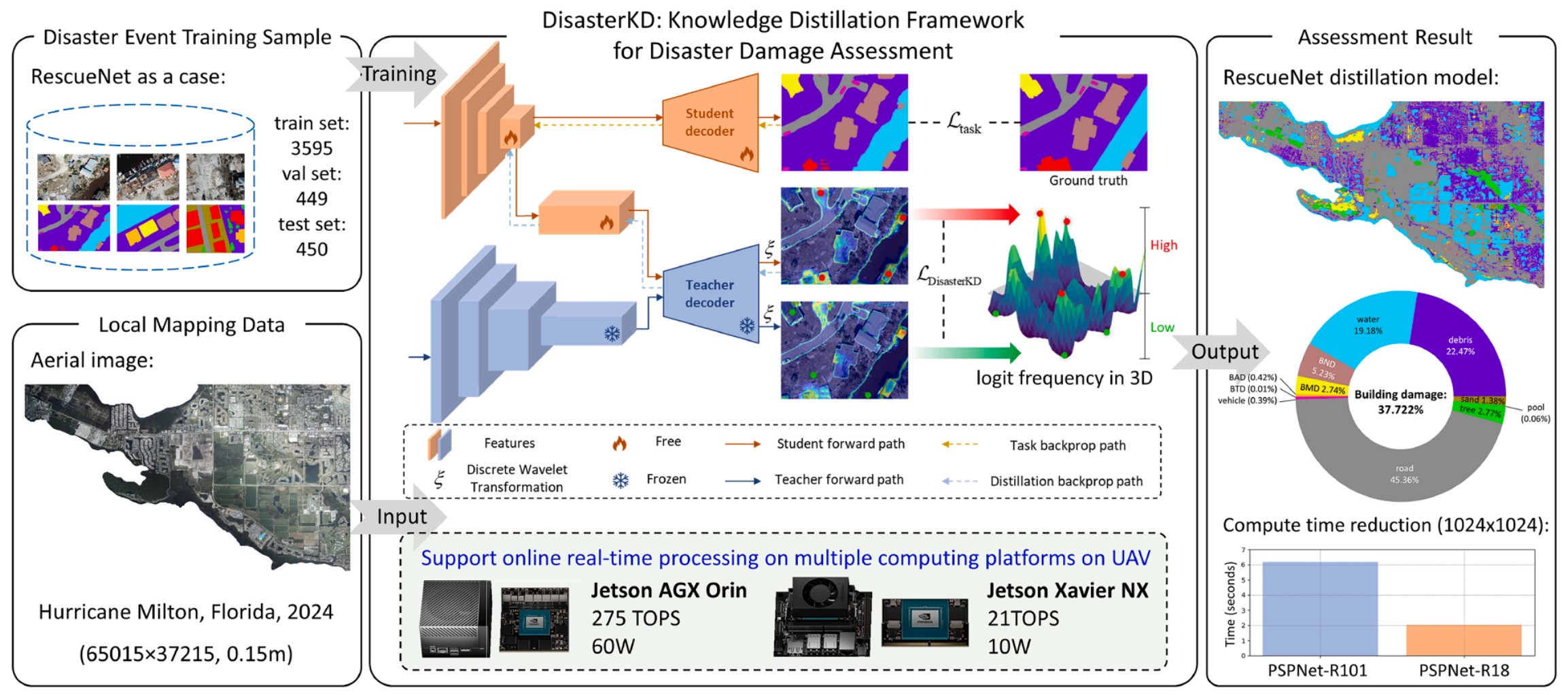

数据集概述

DisasterKD在两个典型的无人机灾害遥感语义分割数据集上进行验证:RescueNet与FloodNet。RescueNet来源于飓风Michael灾后UAV影像,包含4494张高分辨率图像,并提供11语义类别标注,用于刻画灾后建筑、道路、植被、水体以及多类灾损要素;FloodNet来源于飓风Harvey洪涝灾害场景,共2343张图像并包含10类语义类别标注,覆盖洪涝影响下的城市与自然场景要素。

方法概述

DisasterKD面向复杂的灾害场景,提出“频率引导+跨解码器”的知识蒸馏框架,旨在让轻量学生模型在边缘端部署条件下仍能优先保留最关键的灾害结构信息,并降低蒸馏过程中的矛盾监督干扰。方法首先通过小波变换实现频率域知识分解,将预测结果中的灾害相关信息拆分为高频边界线索与低频语义成分,并据此构建具有优先级的渐进式学习策略,以提高关键结构细节的学习效率与保真度;在此基础上进一步提出跨解码器蒸馏机制,冻结教师解码器作为稳定参考框架,将潜在的冲突监督信号主要限制在学生编码器层,从而避免其对学生全网络端到端学习造成不稳定影响。

|

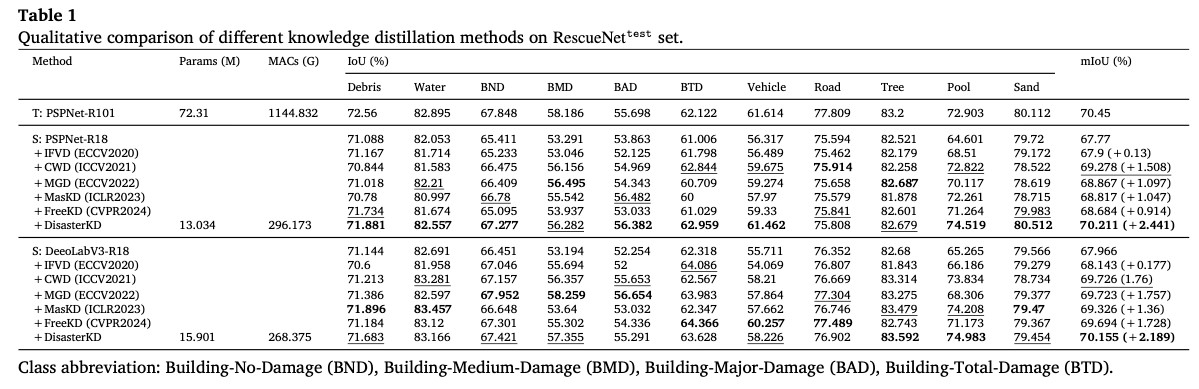

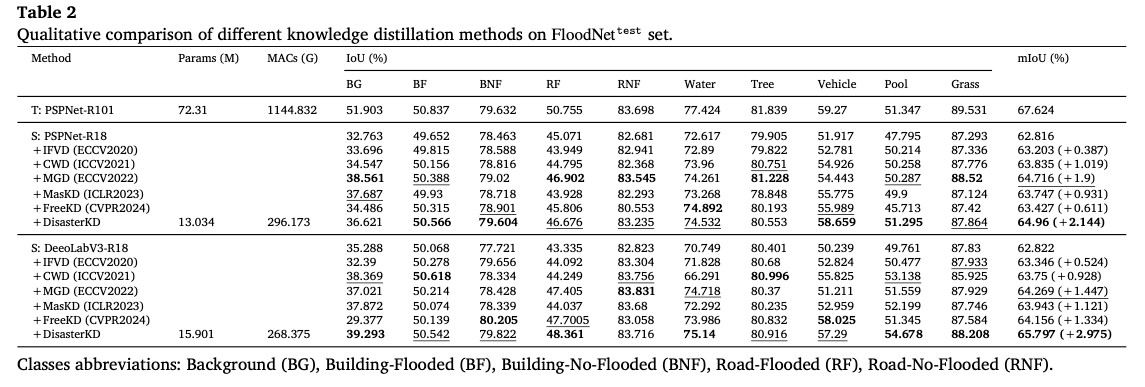

实验验证

在RescueNet和FloodNet两个灾害评估数据集上,DisasterKD显著超越现有知识蒸馏方法,学生网络精度接近教师模型的同时实现了参数量减少超过80%和边缘端推理速度提升约3倍。

|

|

|

RescueNet数据集实验结果表

|

|

|

|

FloodNet数据集实验结果表

|

|

|

|

|

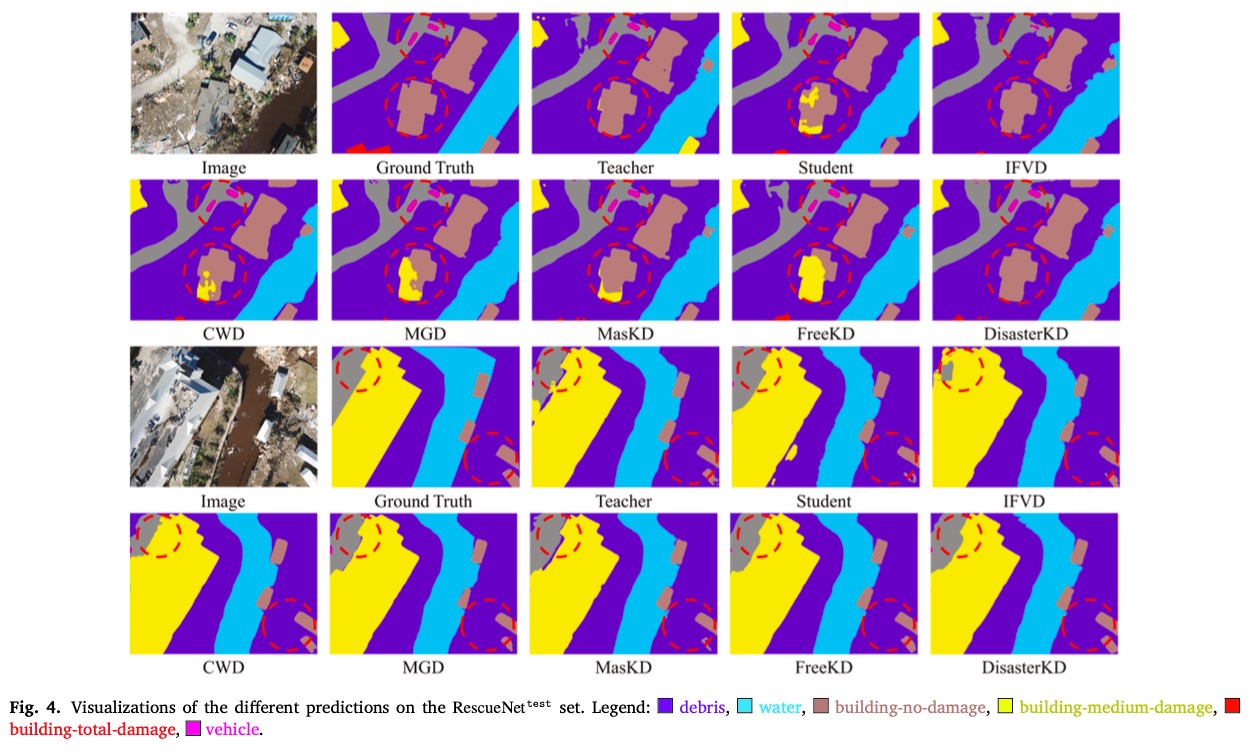

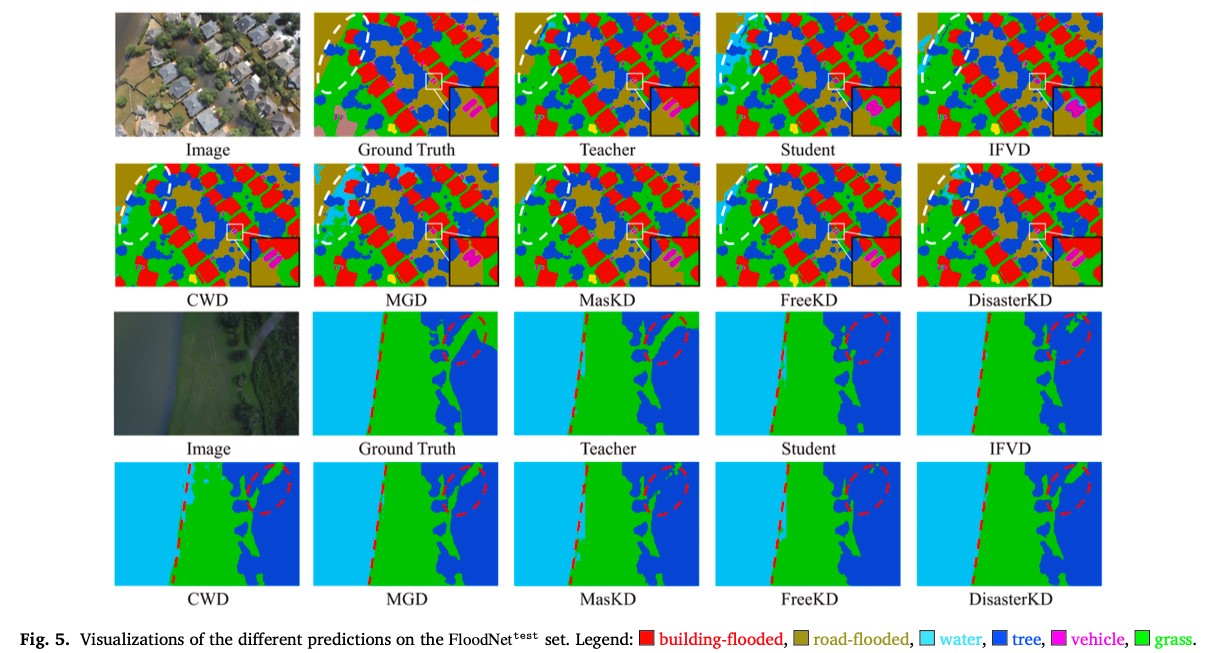

RescueNet和FloodNet数据集实验结果图

|

应用研究

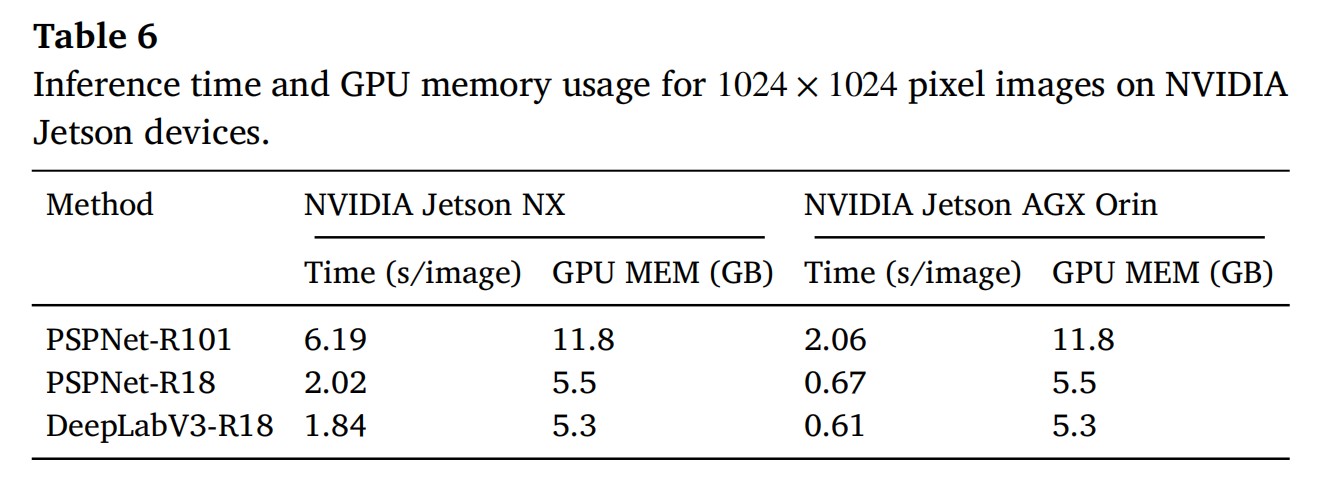

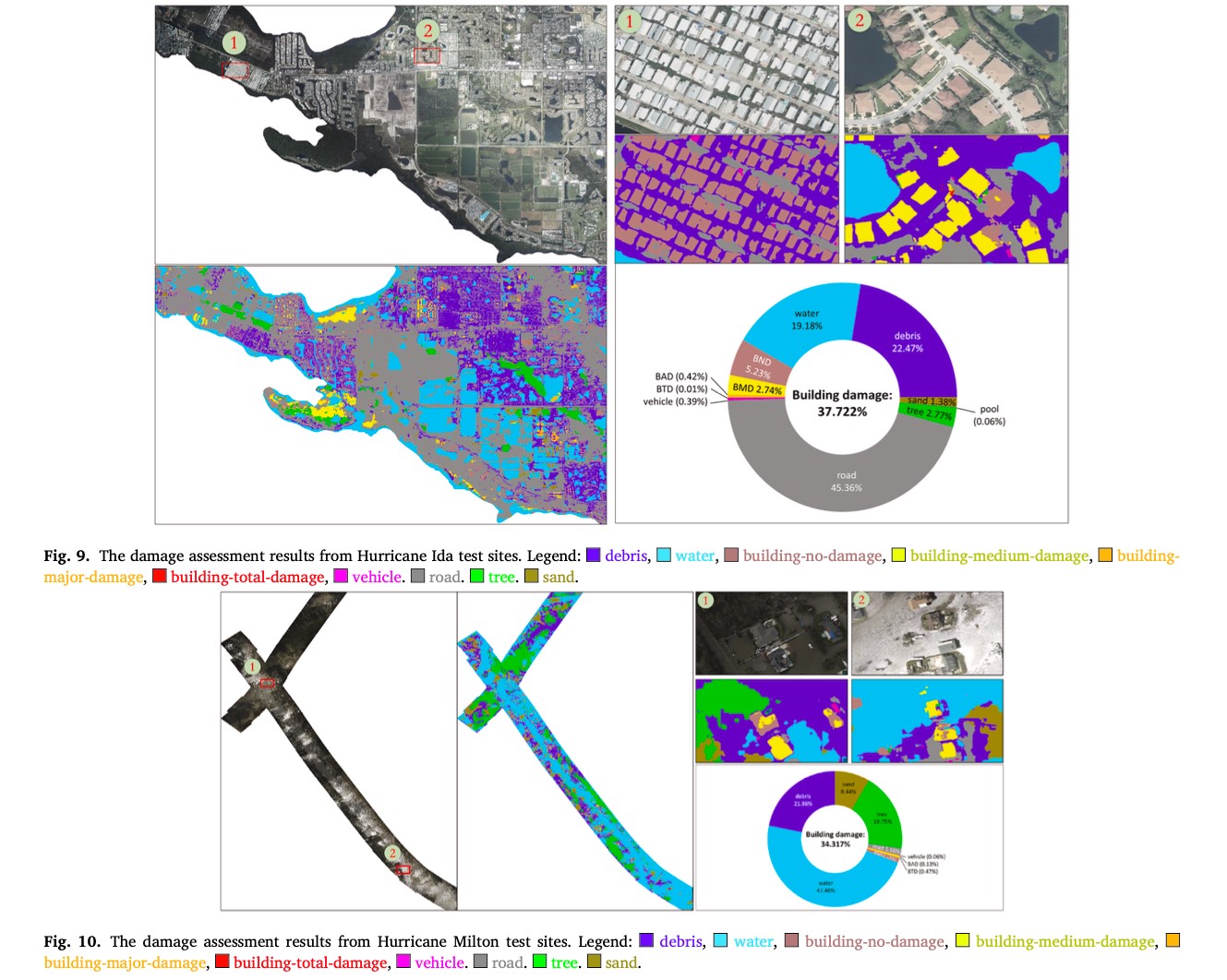

在真实飓风灾害场景(Hurricane Ida和Milton)的跨事件测试中,模型成功识别建筑轮廓和基本损毁模式,并在UAV边缘设备(Jetson NX/AGX Orin)上验证了实时处理能力,证明了该框架在应急响应中的实用价值。

|

|

|

无人机端边缘计算设备推理速度

|

|

|

|

真实飓风灾害场景(Hurricane Ida和Milton)的跨事件测试

|

版权及联系方式

DisasterKD版权归智能化遥感数据提取分析与应用研究组(RSIDEA)所有,该研究组隶属于武汉大学测绘遥感信息工程全国重点实验室(LIESMARS),仅限于学术目的使用,并需引用以下论文,任何商业用途均被禁止。

参考文献:

[1] Jianchong Guo, Yuting Wan, Junjue Wang, Ailong Ma, and Yanfei Zhong. DisasterKD: Frequency-guided cross-decoder knowledge distillation for UAV real-time disaster damage assessment. Pattern Recognition, 2026, 174, 112968. DOI: 10.1016/j.patcog.2025.112968.

如果您在使用DisasterKD时有任何问题或反馈,请联系:

郭鉴翀 博士生: jianchongguo@whu.edu.cn

万瑜廷 副教授: wanyuting@whu.edu.cn

供稿:郭鉴翀 排版:柯天 审核:吴娇、万瑜廷