| 年小组动态 |

| 其它年份小组动态 |

|

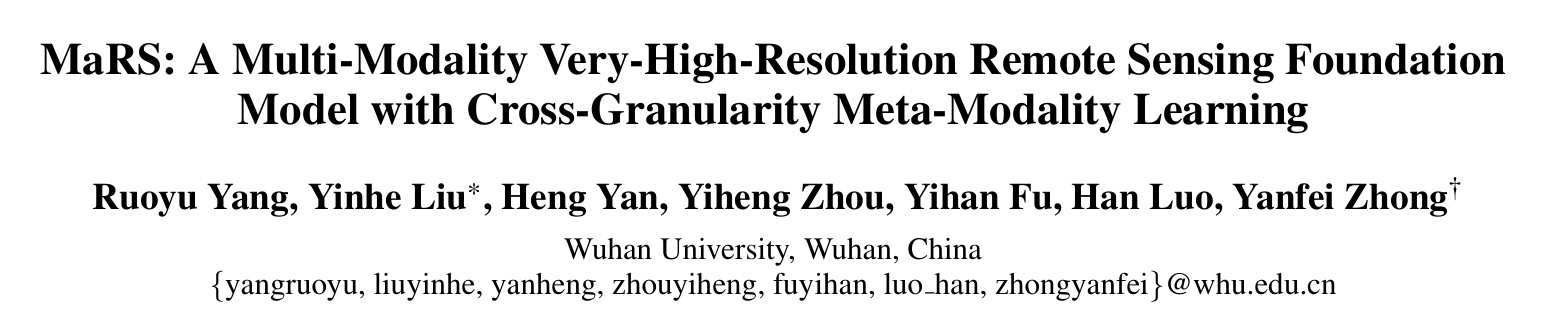

论文标题:MaRS: A Multi-Modality Very-High-Resolution Remote Sensing Foundation Model with Cross-Granularity Meta-Modality Learning

项目网站:https://rsidea.whu.edu.cn/mars.htm

论文:https://rsidea.whu.edu.cn/mars.pdf

代码:https://github.com/WanderRainy/MaRS

收录会议:AAAI 2026

研究背景

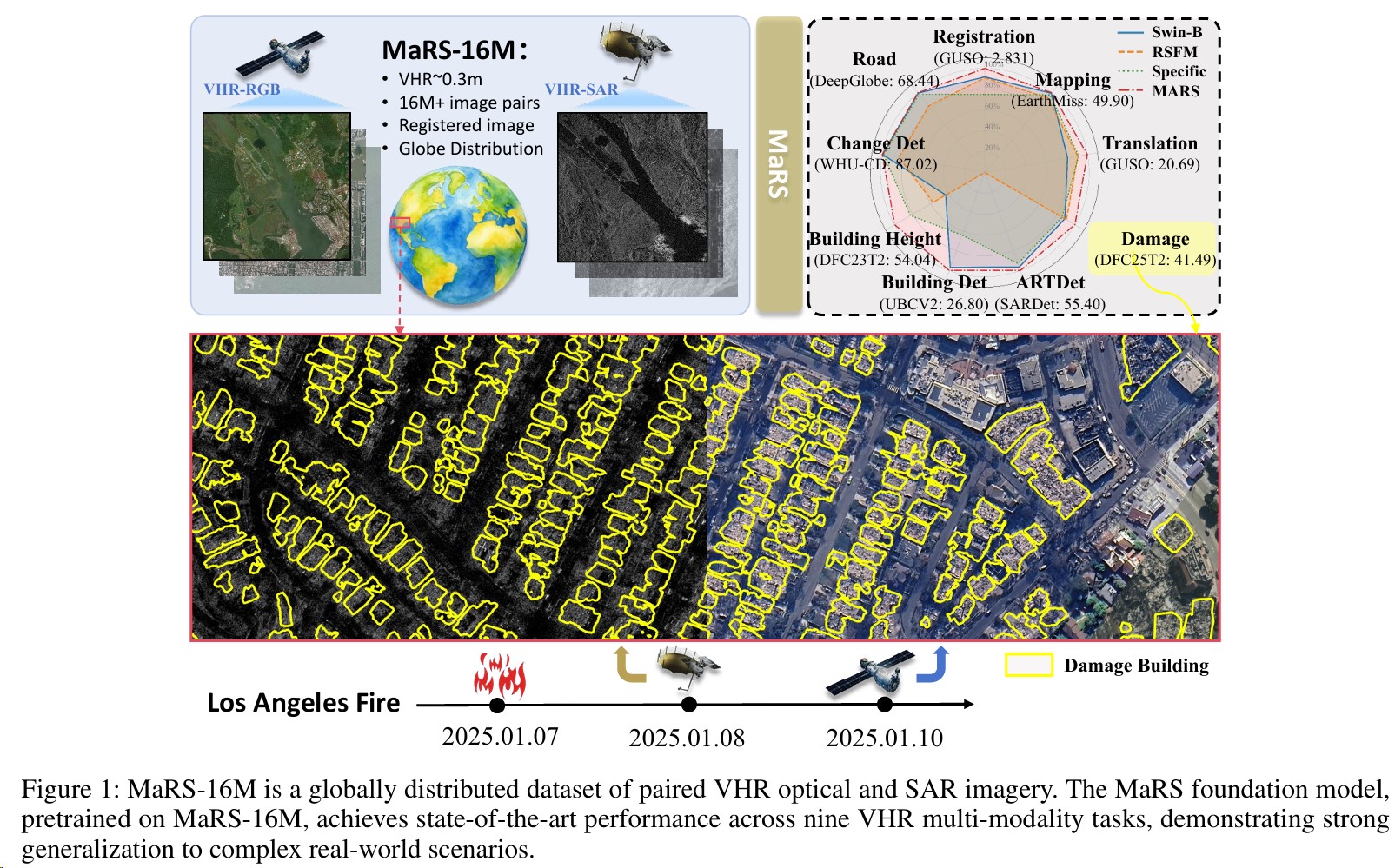

现有一些遥感基础模型 (RSFMs) 通常聚焦在 多模态但 中低分辨率数据,如谷歌的AlphaEarth和武大的Skysense++,或 单模态 + 高分辨率 (通常为光学图像),如Meta的DINOv3。而对于高分辨率 (VHR) + 多模态 (光学 + SAR) 的场景,缺乏大规模、配对良好、系统性的数据集和强通用 model backbone。

在诸如城市、灾害、复杂地形、混合地表覆盖 (urban / rural / forest / water / disaster-affect zones) 等实际遥感应用场景中,仅依赖单一模态 (例如光学) 往往无法获得完整的信息 —— SAR 可以补充光学在阴影、夜间、天气不佳、云雾等条件下的观测能力。类似地,仅有中低分辨率、多模态数据在细节级 (sub-meter 级) 的识别能力也不足。 这些环境使得传统模型“难以直接利用”。

因此,迫切需要构建一个 大规模、高分辨率、全球分布、光学-SAR 配对 (paired) 的多模态遥感数据集,并基于此训练一个 通用 (multi-task)、能够对多种地物 / 地表 /灾害 /变化进行理解和分析 的基础模型 (foundation model)。 MaRS 就是在这样的背景 / 动机下被提出。

|

主要创新点

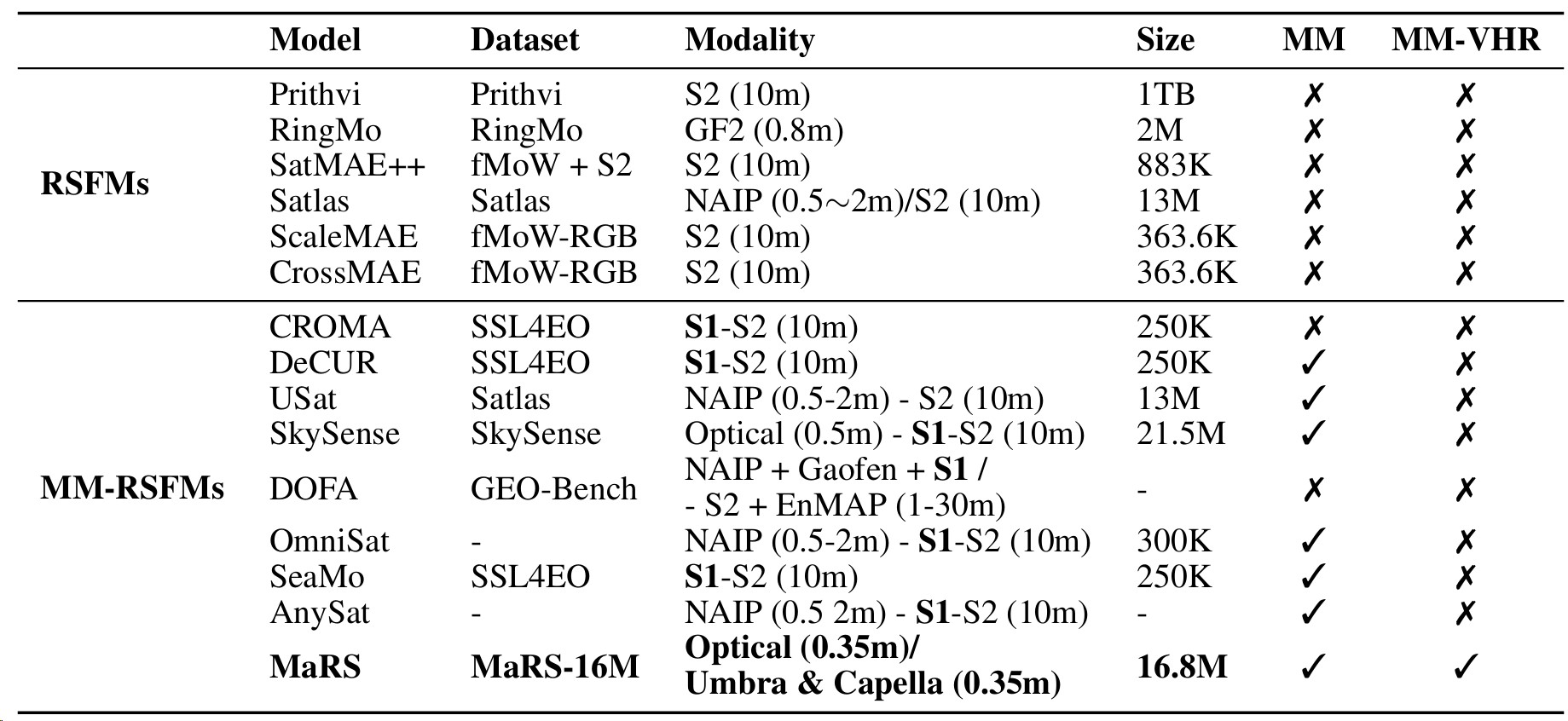

大规模 VHR 多模态配对数据集:MaRS 16M — 该数据集包含约 16,785,168 对 SAR-optical 补丁 (patch pairs),空间精度约 0.35 米 GSD,覆盖全球多地、多地物类型、多场景 (城市 / 农村 /灾害区 /复杂地形等) 。 这是一个在 VHR + 多模态遥感领域中少见的大规模配对数据集,极大丰富了训练/预训练资源。

|

|

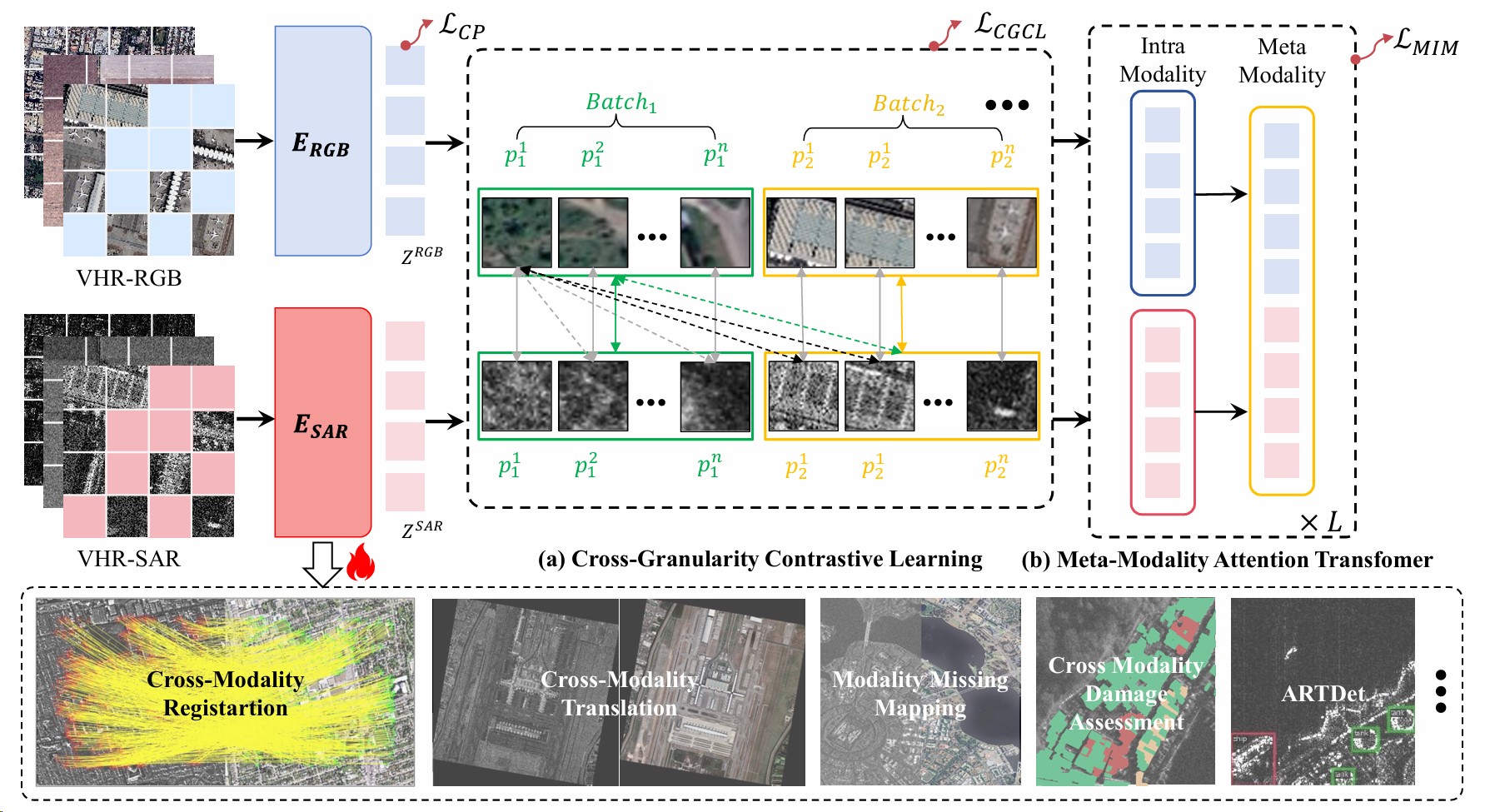

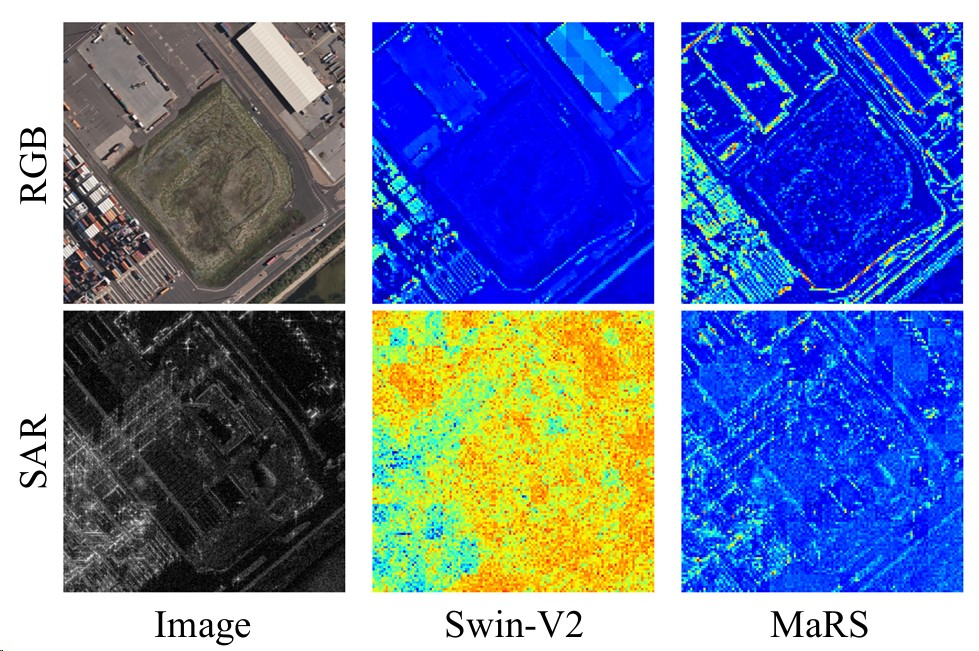

双编码器 + 融合架构 (Dual-Encoder + Meta Modality Attention, MMA) — MaRS 对光学 (RGB/optical) 与 SAR 分别用两个编码器 (基于 SwinV2) 提取各自模态特征,再通过 MMA 模块 (交替进行同模态注意力 + 跨模态注意力) 将它们融合到统一特征空间,实现异模态特征的对齐与融合,缓解物理成像机制差异。

Cross Granularity Contrastive Learning (CGCL) — 为了解决 VHR 遥感图像中 patch-level (局部) 与 image-level (整体) 语义 / 几何 对齐不一致的问题,MaRS 提出 CGCL,将局部 (patch) 与全局 (image) 语义 / 表征进行对比学习,使模型能够兼顾细粒度细节与全局语义一致性,从而增强对复杂场景 (特别是细节丰富、边缘混杂、模态差异大的) 的理解能力。

|

通用预训练 + 多任务适用 (Foundation Model设计) — MaRS 并不是为某个单一任务 (如分割 / 检测) 而构建,而是作为一个 多模态 + 超高分辨率 + 通用 backbone,可迁移到多种下游任务 (配准、模态缺失制图 / mapping、图像翻译 / translation、变化 / 损毁检测、目标检测 / 建筑 /道路 /物体 /高程 /高度估计等) 上。这样的设计大幅降低了为每个任务单独训练模型的重复成本。

性能突破

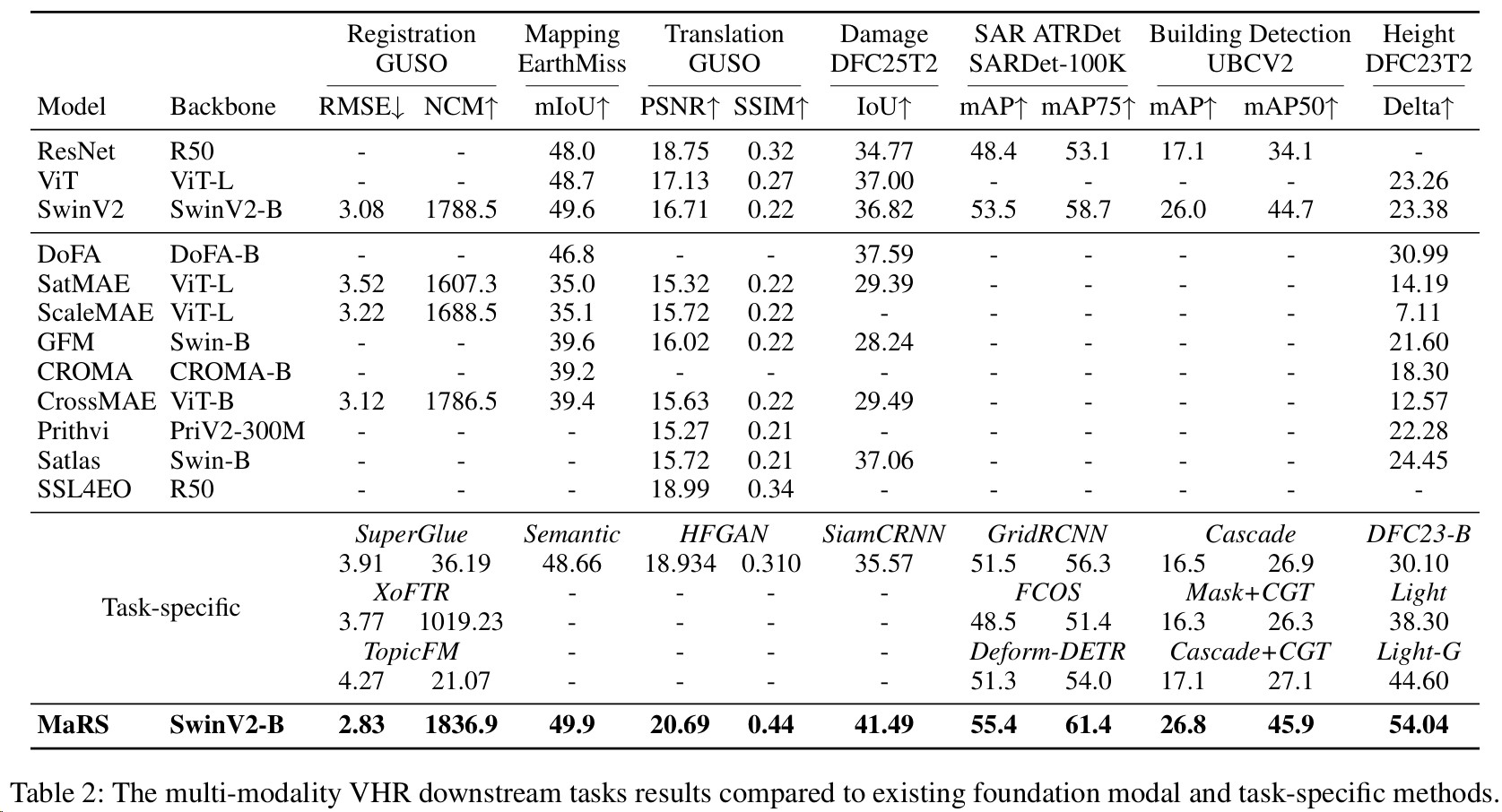

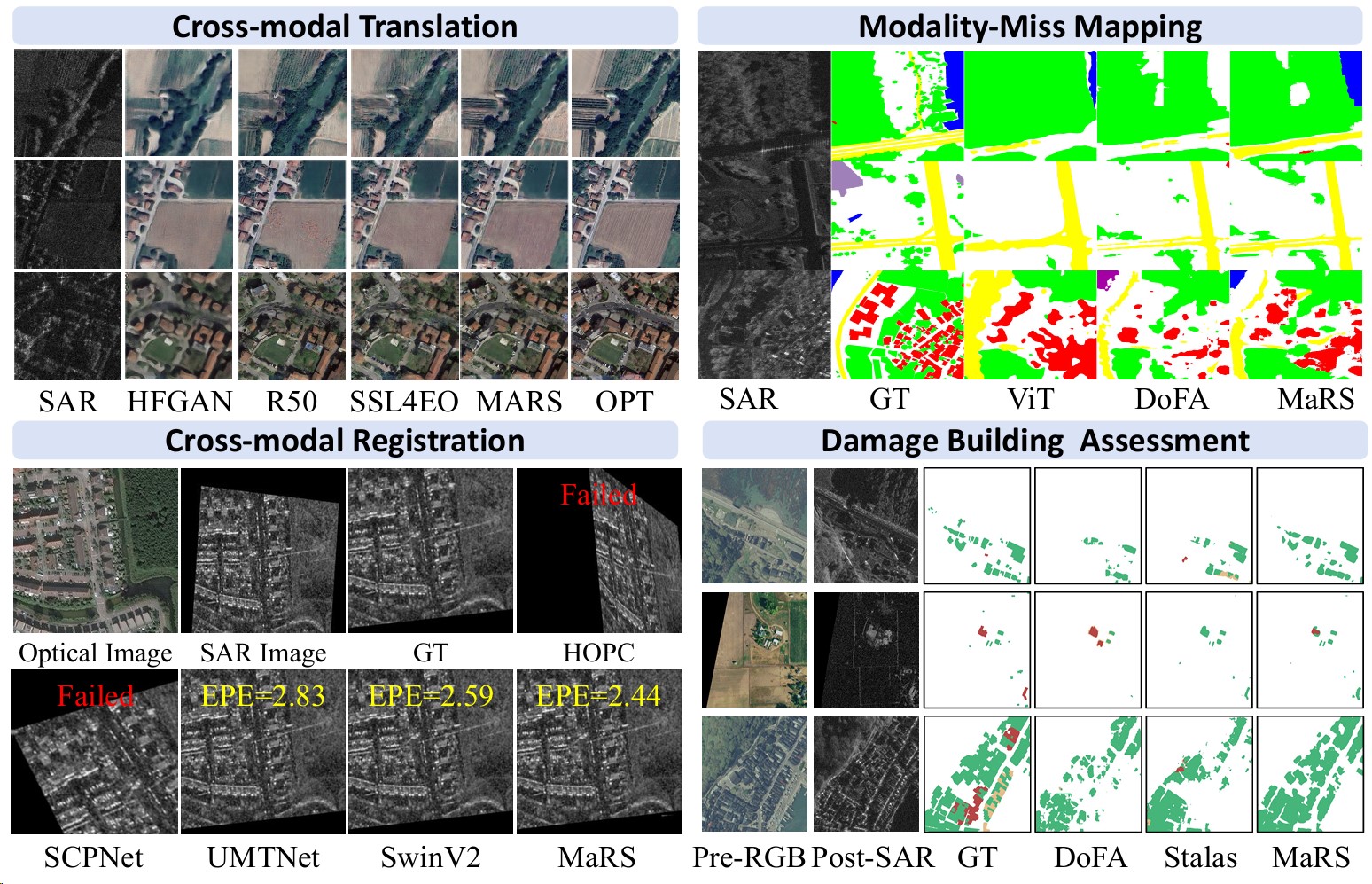

根据 MaRS 官方结果 (在九类代表性 VHR 多模态任务上),MaRS 展现出强大的性能与泛化能力。部分典型结果如下:

跨模态配准 (Registration):RMSE ≈ 2.83

模态缺失制图 (Modality-Missing Mapping / mapping under missing modality): mIoU ≈ 49.90

跨模态图像翻译 (Translation):PSNR ≈ 20.69 + SSIM 提升

SAR 目标 / 建筑 /物体检测 (Detection / Building Detection): 在标准数据集上达到 mAP ≈ 55.40 (SAR 目标) / mAP ≈ 26.80 (建筑物检测)

建筑高度 / 高程估计:高度误差 Δ ≈ 54.04

变化检测 / 损毁 /灾害评估 (Change / Damage Detection):IoU ≈ 87.02 (optical change detection) 或 IoU ≈ 41.49 (灾害损毁评估)

道路提取 (Road Extraction):IoU ≈ 68.44 (on optical)

此外,MaRS 表现出 对城市 /灾害 /复杂地形 /多源 /多时相数据的良好泛化能力和鲁棒性,其特征表达在物体边缘和细节区域更加清晰 (sharp activations),并且在不同模态 (光学 / SAR) 之间表现出更高的一致性 (modality-invariant representation)。

|

|

|

总结

由于传统遥感基础模型 /数据集 在 “模态 / 分辨率 /通用性 /多任务 + 多源融合” 方面的局限,使得它们难以满足 高分辨率 + 多模态 + 复杂 /真实地表场景 (城市 /灾害 /混合地形 /多地物 /多时相) 的需求。MaRS 的提出,通过构建大规模、高分辨率、配对良好的光学–SAR 数据集 (MaRS-16M),结合先进的融合 + 对比学习架构 (MMA + CGCL),以及通用 backbone 设计,为遥感领域提供了一个强大的、多任务适用、多场景兼容的基础模型。这对推动遥感 + 人工智能在城市规划、灾害监测、环境监测、土地 /地表 /资源 /变化分析等实际应用中具有重要意义。

研究团队

该成果由武汉大学 RSIDEA 高分辨率遥感影像理解研究团队 在前期系列研究基础上进一步拓展完成,历时一年系统攻关,凝聚了全体师生的集体智慧与协作精神。研究工作由 钟燕飞教授、刘寅贺博士后、马爱龙副教授 共同指导,团队成员 杨若雨、闫恒、周逸恒、付一涵、罗梒 等密切配合,在模型设计、实验构建与任务测试等方面通力合作。

团队高效完成了 跨模态高分辨率配准、跨模态高分辨率翻译、模态缺失条件下地表覆盖制图、跨模态损毁评估、SAR 重要目标检测、SAR 建筑物提取、SAR 建筑物高度估计、高分辨率道路提取、高分辨率变化检测 九项典型下游任务的系统性测试,并在 洛杉矶山火真实案例 中验证了模型在复杂实际场景下的优越泛化能力,充分展现了团队在重大技术攻关与多任务协同执行中的实力与默契。

本研究同时获得了 国家自然科学基金青年科学基金项目(A类,42325105) 的支持。

供稿:杨若雨 排版:柯天 审核:吴娇、刘寅贺